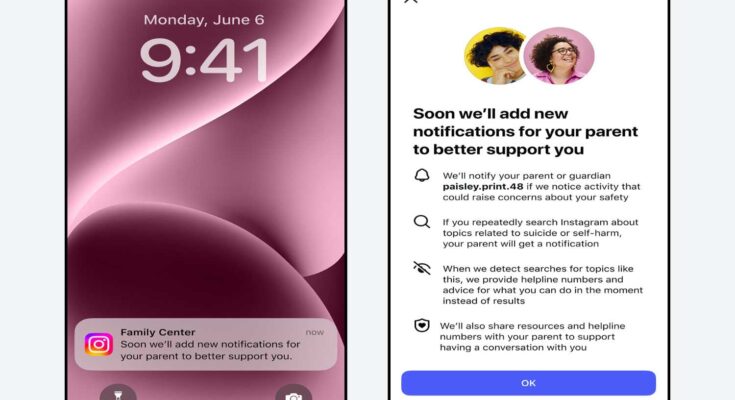

La società di Mark Zuckerberg ha comunicato che Instagram comincerà a inviare avvisi ai genitori qualora i loro figli minorenni effettuino continue ricerche su argomenti quali il suicidio o l’autolesionismo in un periodo limitato. Una comunicazione che può giungere tramite applicazione, messaggio di testo o anche WhatsApp. Non una semplice notifica automatica, ma un campanello d’allarme riguardo una questione estremamente sensibile e di grande rilevanza.

L’aggiornamento interessa i profili di giovani utenti associati a un meccanismo di monitoraggio parentale. Soltanto chi ha deciso di attivare questa funzionalità di controllo riceverà la segnalazione. Non parliamo di sorveglianza indiscriminata, bensì di uno strumento specifico ideato per individuare circostanze potenzialmente a rischio.

Il funzionamento del nuovo sistema di tutela

Il dispositivo entra in azione nel momento in cui un adolescente impiega ripetutamente la barra di ricerca per visualizzare materiali connessi all’autolesionismo. In tale eventualità, oltre al blocco immediato dei risultati problematici e all’orientamento verso servizi di sostegno psicologico, viene generata una comunicazione diretta verso il profilo del tutore.

L’avviso non si ferma alla mera segnalazione del comportamento. Sarà integrato con contenuti educativi realizzati con la collaborazione di specialisti, studiati per assistere i genitori nell’affrontare dialoghi complessi con i propri ragazzi. Il proposito dichiarato è trasferire il focus dalla mera vigilanza alla prevenzione informata. Il programma partirà dapprima in Stati Uniti, Regno Unito, Australia e Canada. Altre nazioni, incluse Francia e Spagna, si stanno organizzando per implementare dispositivi analoghi, mentre l’ampliamento ad ulteriori territori è programmato nelle settimane successive.

Dalle ricerche ai chatbot: l’espansione del controllo

L’innovazione non rimarrà limitata alle ricerche di immagini o video brevi. Nelle settimane a venire gli alert includeranno anche gli scambi con Meta AI, l’assistente virtuale incorporato nell’ambiente della piattaforma. Una decisione che rispecchia una condizione ormai palese: numerosi adolescenti, quando necessitano di risposte personali o angoscianti, si affidano proprio alle intelligenze artificiali dialoganti.

L’argomento è complesso. Secondo uno studio citato da Reuters, analisi interne condotte da Meta avrebbero mostrato come tra i giovani regolarmente esposti a materiali che provocano insoddisfazione verso il proprio aspetto fisico sia significativa la diffusione di patologie alimentari. Un elemento che consolida l’esigenza di meccanismi di salvaguardia più efficaci.

Equilibrio tra protezione e responsabilità online

La nuova opzione si colloca in un programma più vasto di difesa degli utenti minorenni. Instagram già riduce l’esposizione a materiali nocivi e indirizza verso linee telefoniche di supporto, ma con questa mossa introduce un fattore aggiuntivo: la condivisione della responsabilità con le famiglie.

Permane il confronto sul limite tra protezione e riservatezza personale. Ciononostante, il messaggio appare inequivocabile: davanti a indicatori ripetuti di malessere, la piattaforma ha optato per un intervento attivo. In uno scenario digitale dove le ricerche possono rimanere nascoste e impercettibili, un semplice avviso potrebbe rivelarsi decisivo per salvare un’esistenza.

Fonte: Meta